Analytics-Trends 2026 zeigen dir, wie sich Analytics von nachgelagerten Reports zu einem System entwickelt, das Entscheidungen in Marketing, Produkt und Business direkt mitsteuert. Statt nur Kennzahlen rückblickend zu zählen, rücken Cookieless-Tracking, First-Party-Data, AI-gestützte Modelle und schnellere Entscheidungswege in den Mittelpunkt.

In diesem Artikel zeige ich dir, welche Analytics-Trends 2026 wirklich Substanz haben. Wenn dir vorher der Überblick über Grundlagen wie Tracking, Events und Analytics-Methoden fehlt, lohnt sich ein Blick in unseren Marketing-Analytics-Guide, bevor du hier tiefer einsteigst.

Die wichtigsten Analytics-Trends 2026 im Überblick

Analytics-Trends 2026 drehen sich vor allem um Cookieless-Tracking und robuste First-Party-Data-Strategien, AI-gestützte Entscheidungsfindung auf Basis moderner Analytics-Architekturen, Real-Time- und Prescriptive-Analytics, die Signale in Echtzeit nutzbar machen, sowie Embedded-Analytics und Self-Service-BI, die Insights direkt in die Arbeitsabläufe der Teams holen. Dazu kommen Data-as-a-Product und Data-Marketplaces, AI-Agenten mit Agent-Ready-Data, Synthetic-Data und Privacy-Enhancing-Technologies sowie neu gedachte Attribution–Ansätze, die deine bisherigen Modelle und Reports spürbar unter Druck setzen.

Diese Themen sind nicht einfach Schlagworte, sondern zeigen, wohin sich Analytics in der Praxis bewegt: weg von isolierten Reports hin zu Setups, in denen Daten direkt Entscheidungen auslösen oder zumindest sehr konkret vorbereiten. Die Trends greifen ineinander, weil sie die gleichen Baustellen adressieren: Datenlücken durch Datenschutz, steigende Erwartungen an Geschwindigkeit und Präzision sowie den Wunsch nach weniger manueller Reporting-Arbeit.

- Cookieless-Tracking und First-Party-Data: Analytics-Setups, die ohne Third-Party-Cookies auskommen, Consent respektieren und eigene Datenquellen konsequent nutzen.

- Moderne Architektur und Decision-Intelligence: Lakehouse, DataOps und Modelle, die aus Daten konkrete Handlungsoptionen machen.

- Real-Time- und Prescriptive-Analytics: von Monatsreporting zu Live-Signalen und automatisierten Alerts, die früh auf Risiken und Chancen hinweisen.

- Embedded-Analytics und Self-Service-BI: Insights direkt dort, wo Teams arbeiten, statt in isolierten Dashboards zu verstauben.

- AI-Agenten und Agent-Ready-Data: Assistenten, die Abfragen formulieren, Ergebnisse einordnen oder gleich Folgeaktionen anstoßen.

- Data-as-a-Product und Data-Marketplaces: Daten werden wie Produkte mit Owner, Qualität und klaren Schnittstellen behandelt.

- Synthetic-Data und Privacy-Enhancing-Technologies: künstlich erzeugte Daten und Privacy-Techniken, um sensible Use Cases trotzdem zu ermöglichen.

- Attribution neu gedacht: Modelle, Experimente und incrementality statt reinem Last-Click-Denken.

Die folgenden Kapitel steigen in genau diese Trends tiefer ein und übersetzen sie in Entscheidungen, die du für dein eigenes Analytics-Setup treffen musst.

Warum diese Trends 2026 gleichzeitig Druck machen

Dass Analytics-Trends 2026 geballt auftauchen, liegt daran, dass mehrere Entwicklungen gleichzeitig auf dein Setup wirken. Datenschutz und das Ende der Third-Party-Cookies schneiden Datensignale ab, die viele Jahre selbstverständlich waren. AI bringt auf einmal Tools und Modelle in Reichweite, die vorher eher Forschungsprojekte waren. Gleichzeitig wollen Stakeholder deutlicher sehen, welche Maßnahmen wirklich Wirkung haben.

In vielen Unternehmen wird dadurch schmerzhaft sichtbar, dass historische Lösungen aus gewachsenen Tracking-Konfigurationen, manuellen Exports und isolierten Dashboards nicht mehr mithalten. Die Trends zwingen dich indirekt dazu, Entscheidungen über Architektur, Kompetenzen und Prioritäten zu treffen, statt alles weiterlaufen zu lassen wie bisher.

- Datenschutz und Cookieless: weniger direkt messbare Nutzerpfade, mehr Fokus auf First-Party-Data und Modellierung.

- AI und neue Tools: Auswertungen, die früher Tage dauerten, können automatisiert oder in Minuten erledigt werden, wenn die Datenbasis stimmt.

- Business-Druck: Budgets müssen stärker begründet werden, Experimente und Modelle sollen zeigen, was wirklich wirkt.

Genau deshalb sind Analytics-Trends 2026 keine nette Spielwiese, sondern ein Signal, dass du dein Setup aktiv weiterentwickeln solltest: weg von Stückwerk und hin zu einer Struktur, in der diese Entwicklungen dir helfen, statt dich zusätzlich zu überfordern.

Wie du Trend und Hype auseinanderhältst

Bei Analytics-Trends 2026 prasseln ständig neue Begriffe auf dich ein, aber nicht jedes Schlagwort verdient ein Projekt. Ein echter Trend ist eine Entwicklung, die sich quer über Branchen durchsetzt und dauerhaft bleibt, weil sie ein reales Problem löst. Hype lebt davon, dass er Aufmerksamkeit erzeugt, liefert aber selten tragfähige Antworten auf deine konkreten Fragen.

Für deine Planung ist wichtig, nüchtern zu prüfen, ob ein Thema dein Analytics-Setup strukturell besser macht oder nur eine weitere Schicht Komplexität einführt. Je mehr du dich auf Trends konzentrierst, die deine bestehenden Engpässe adressieren, desto weniger wirst du von Tool zu Tool springen.

- Echter Trend: taucht wiederkehrend bei großen Plattformen, Standards und Unternehmen auf und verbessert nachweisbar Geschwindigkeit, Qualität oder Verlässlichkeit deiner Entscheidungen.

- Hype: basiert auf Präsentationen und Posts, die vor allem das Gefühl erzeugen, etwas zu verpassen, ohne klar zu zeigen, welches Problem gelöst wird.

Ein praktischer Filter ist deshalb hilfreich: Wenn ein Thema dir hilft, eine konkrete wiederkehrende Frage besser zu beantworten, lohnt sich die Auseinandersetzung. Fehlt dieser Bezug, kannst du es bewusst parken, statt Ressourcen daran zu verbrennen.

Trend Nr.1: Cookieless-Tracking und First-Party-Data

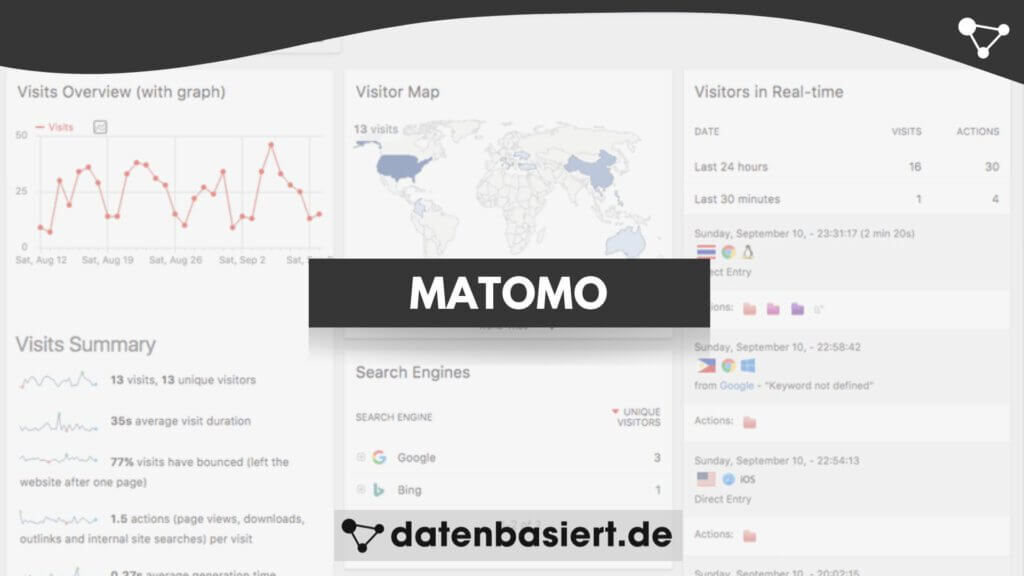

![]()

Das Ende der Third-Party-Cookies und was es für Analytics heißt

Cookieless-Tracking setzt voraus, dass du Analytics nicht mehr auf Third-Party-Cookies aufbaust, sondern auf Signale, die auch ohne plattformübergreifendes Tracking funktionieren. Das Ende der Third-Party-Cookies bedeutet für dich weniger direkte User-Journeys über mehrere Domains hinweg, weniger exakte Retargeting-Zielgruppen und deutlich mehr Fokus auf deine eigenen Datenquellen.

Viele bisher gewohnte Dinge brechen weg: Frequency Capping über mehrere Websites, klassische View-Through-Attribution für Display-Kampagnen, Cross-Device-Tracking über Third-Party-IDs. Gleichzeitig entsteht Raum für Setups, die transparenter, stabiler und weniger abhängig von einzelnen Browsern oder Adtech-Anbietern sind.

- Tracking über Third-Party-Cookies verliert an Reichweite und Verlässlichkeit oder fällt komplett weg.

- Messung verschiebt sich von exakten individuellen Pfaden hin zu aggregierten, modellierten Ergebnissen.

- Eigene Kanäle und Logins werden wichtiger, weil dort verlässlichere Signale entstehen.

Cookieless-Tracking heißt in diesem Kontext nicht, auf Insights zu verzichten, sondern Messmodelle und Datenquellen so zu verändern, dass sie Datenschutz respektieren und trotzdem nutzbare Antworten liefern.

First-Party-Data als neues Analytics-Fundament

First-Party-Data ist der Kern von Analytics-Trends 2026, weil es Daten sind, die direkt auf deinen eigenen Kanälen unter deiner Marke entstehen. Dazu gehören Logins, Newsletter-Anmeldungen, Käufe, Support-Kontakte, Interaktionen in deiner App, Antworten auf Umfragen oder gespeicherte Präferenzen in einem Kundenkonto.

Der entscheidende Punkt: Diese Daten bekommst du nur, wenn Nutzer einen klaren Mehrwert sehen und ihrer Nutzung aktiv zustimmen. Ein Value-Exchange ist keine Floskel, sondern Voraussetzung dafür, dass du langfristig eine belastbare Datenbasis aufbaust.

- Interaktionen auf Website, App, Shop oder Community als messbare Signale.

- Deklarierte Informationen wie Interessen, Branchen, Rollen oder Use Cases.

- Verhaltensdaten wie Käufe, Warenkörbe, Nutzungsintensität und Feature-Nutzung.

First-Party-Data macht Analytics robuster, weil du dich weniger auf externe Identifier verlässt und mehr auf Daten, die näher an deiner Kundenbeziehung liegen. Das stärkt nicht nur Reporting und Segmentierung, sondern auch Personalisierung und Prognosen.

Server-Side-Tracking und Consent richtig kombinieren

Server-Side-Tracking ist kein Zaubertrick, um Datenschutz zu umgehen, sondern ein Weg, Datenerhebung stabiler, sicherer und kontrollierbarer zu machen. Events werden nicht mehr nur im Browser verarbeitet, sondern über einen eigenen Server oder Tagging-Server, der als Kontrollpunkt zwischen Website oder App und den Zielsystemen sitzt.

Damit das zu Cookieless-Tracking passt, muss Consent sauber angebunden werden. Das heißt: Es braucht eine klare Einwilligung, ein transparentes Consent-Interface und eine technische Verbindung zur Server-Side-Logik, damit Events nur in den Systemen landen, für die Nutzer zugestimmt haben.

- Consent zuerst klären und dokumentieren, dann Events ausliefern.

- Events über einen eigenen Server leiten, um sie zu validieren, anzureichern oder zu filtern.

- Systeme, die keinen Consent haben, konsequent sperren, statt sie in Grauzonen weiter zu füttern.

Server-Side-Tracking hilft dir, weniger anfällig für Browser-Updates zu werden, Datenqualität zu verbessern und sensible Datenpunkte gezielter zu schützen, wenn Consent und Governance ernst genommen werden.

Context statt Profil: Cookieless-Auswertung

Wenn weniger individuelle Nutzerdaten zur Verfügung stehen, wird Kontext wichtiger als Profile. Statt sich auf detaillierte Bewegungsprofile zu stützen, nutzt Cookieless-Tracking Kontextsignale wie Inhalt, Zeitpunkt, Gerätetyp, Kanal oder grobe Standortinformationen und kombiniert sie mit aggregierten Auswertungen.

AI-Modelle können auf dieser Basis dennoch Muster erkennen, zum Beispiel welche Inhalte in welchem Kontext gut funktionieren oder welche Kombinationen von Touchpoints häufiger zu Conversions führen. Der Fokus verschiebt sich von individuellen Journeys hin zu Kohorten, Szenarien und Wahrscheinlichkeiten.

- Kontextsignale wie Inhalt, Format, Uhrzeit, Endgerät und Umfeld als Basis für Auswertungen.

- Kohorten und Segmente statt einzelner Nutzerpfade als Standardperspektive.

- Modellierung, um fehlende Datenpunkte abzuschätzen, ohne zusätzliche Personenprofile anzulegen.

Cookieless-Tracking arbeitet damit eher mit Tendenzen, Mustern und Wahrscheinlichkeiten als mit lückenlosen Profilen, liefert aber trotzdem eine solide Grundlage für datenbasierte Entscheidungen.

Trend Nr.2: Moderne Analytics-Architektur und Decision-Intelligence

Lakehouse, Warehouse und Operational-Layer verstehen

Moderne Analytics-Trends 2026 setzen darauf, dass Daten nicht mehr in Dutzenden isolierten Tools liegen, sondern in einer Architektur, in der Rohdaten, kuratierte Schichten und operative Systeme sauber getrennt sind. Lakehouse- und Warehouse-Konzepte helfen, diese Ebenen so aufzubauen, dass sie sowohl flexible Analyse als auch stabile Berichte ermöglichen.

Im Kern geht es darum, unterschiedliche Anforderungen in einer Architektur unterzubringen: explorative Analysen, die viele Rohdaten brauchen, standardisierte Reports mit klar geprüften Kennzahlen und operative Anwendungen, die direkt aus Daten Entscheidungen ableiten oder Prozesse auslösen.

- Data Lake bzw. Lakehouse als Ort für Rohdaten, historische Daten und flexible Explorationsmöglichkeiten.

- Data Warehouse mit kuratierten, bereinigten und modellierten Daten für Reporting, Dashboards und Self-Service-Abfragen.

- Operational-Layer, in dem Datenmodelle in Echtzeit oder nahe Echtzeit in Kampagnen, Produkte oder Workflows einfließen.

Je klarer diese Schichten getrennt sind, desto weniger Zeit verbringst du mit Firefighting bei Reports, die plötzlich andere Zahlen zeigen, und desto mehr Raum entsteht für echte Analyse und Automation.

DataOps und Data-Quality als Pflichtprogramm

Eine moderne Analytics-Architektur steht und fällt mit DataOps, also Prozessen und Werkzeugen, mit denen du Datenpipelines wie Software entwickelst und betreibst. Statt einmal im Jahr über Datenqualität zu sprechen, werden Tests, Monitoring und Versionierung zu festen Bestandteilen des Alltags.

Datenqualität wird dabei nicht auf ein abstraktes Ziel reduziert, sondern in konkrete, überprüfbare Regeln überführt: Welche Felder müssen gefüllt sein, welche Wertebereiche sind gültig, welche Abweichungen lösen einen Alarm aus. So wird sichtbar, wo Probleme entstehen, bevor sie im Reporting oder in Modellen für Ärger sorgen.

- Automatisierte Tests für Datenpipelines, ähnlich wie Unit-Tests im Softwareentwicklungsprozess.

- Monitoring von Volumen, Verteilung und Aktualität, um Ausreißer und Ausfälle früh zu erkennen.

- Klare Verantwortlichkeiten für Datenbereiche, damit nicht alle sich zuständig fühlen, aber niemand wirklich handelt.

DataOps sorgt im Zusammenspiel mit einer passenden Architektur dafür, dass sich Teams auf Inhalte und Entscheidungen konzentrieren können, statt permanent hinter fehlerhaften Zahlen herzuräumen.

Decision-Intelligence statt nur Reporting

Decision-Intelligence erweitert klassisches Reporting um den expliziten Fokus darauf, wie Entscheidungen tatsächlich getroffen werden. Es geht nicht nur darum, Zahlen zu zeigen, sondern darum, Daten, Modelle und Business-Regeln so zu kombinieren, dass nachvollziehbare Handlungsoptionen entstehen.

Typisch ist, dass für eine bestimmte Entscheidungsklasse ein strukturierter Ablauf definiert wird: Welche Daten fließen ein, welche Modelle rechnen Prognosen, welche Regeln begrenzen Risiken und wie fließt Feedback aus getroffenen Entscheidungen zurück, um Modelle und Regeln zu verbessern.

- Identifikation wiederkehrender Entscheidungstypen, zum Beispiel Budgetverteilung, Preise oder Risikofreigaben.

- Kombination aus Prognosemodellen und klaren Business-Regeln, die das Ergebnis einschränken und erklärbar machen.

- Feedback-Schleifen, die Ergebnisse messen und in die Optimierung von Modellen und Regeln zurückspielen.

Decision-Intelligence verschiebt damit den Fokus von reiner Ergebnisdarstellung hin zu strukturierten, datenbasierten Entscheidungsprozessen, die dokumentiert, überprüft und verbessert werden können.

Praxisbeispiele für Decision-Intelligence

In der Praxis zeigt sich Decision-Intelligence überall dort, wo Entscheidungen standardisiert, aber nicht komplett starr sein sollen. In Marketing, Pricing, Produkt oder Risiko-Management entstehen damit Setups, die schnell reagieren und trotzdem kontrollierbar bleiben.

Entscheidend ist, dass Datenmodell, Modelllogik und Business-Regeln bewusst entworfen werden, statt dass einzelne Fachabteilungen jeweils eigene Logiken in Excel oder in Tools verstecken. So wird nachvollziehbar, warum eine Entscheidung getroffen wurde und wie sie sich bei geänderten Annahmen verändern würde.

- Dynamische Budgetverteilung, bei der Kanäle automatisch mehr Budget bekommen, wenn bestimmte Performance-Schwellenwerte erreicht werden.

- Churn-Prevention, bei der Risikoscores, Segmentmerkmale und Angebotsgrenzen zusammen entscheiden, welche Rückgewinnungsmaßnahme ausgelöst wird.

- Pricing-Entscheidungen, bei denen Nachfrageprognosen, Wettbewerbssignale und Margenvorgaben zu konkreten Preisvorschlägen kombiniert werden.

Mit solchen Anwendungsfällen wird deutlich, dass eine moderne Analytics-Architektur nicht nur Reports stabilisiert, sondern direkt in operative Entscheidungen hineinwirkt.

Trend Nr.3: Real-Time-Analytics und Prescriptive-Analytics

Warum klassisches Batch-Reporting nicht mehr reicht

Real-Time-Analytics und Prescriptive-Analytics adressieren das Problem, dass Monats- oder Wochenreports für viele Entscheidungen schlicht zu langsam sind. Wenn Kampagnenbudgets in Stunden verbrannt werden oder Systeme in Minuten ausfallen, reicht es nicht, im nächsten Reporting-Zyklus zu sehen, dass etwas schiefgelaufen ist.

Real-Time-Analytics sorgt dafür, dass Datenströme laufend verarbeitet werden, Prescriptive-Analytics leitet daraus konkrete Handlungsempfehlungen ab. Statt nur rückblickend zu erklären, was passiert ist, werden Abweichungen und Chancen erkannt, während sie entstehen, und mit passenden Aktionen verknüpft.

- Kampagnen, bei denen zu späte Reaktionen Budget kosten oder profitable Zeitfenster ungenutzt bleiben.

- Systeme, bei denen Ausfälle oder Performance-Probleme direkte Umsatzeffekte haben.

- Nutzerverhalten, das nur in engen Zeitfenstern sinnvoll beeinflusst werden kann, etwa in Onboarding- oder Checkout-Flows.

Batch-Reporting behält seinen Platz für Rückblick und Dokumentation, aber kritische Entscheidungen verschieben sich zu Setups, die nah an Echtzeit arbeiten und Vorschläge für nächste Schritte liefern.

Real-Time-Analytics in Kampagnen und Produkten

In Kampagnen zeigt sich Real-Time-Analytics zum Beispiel in Budgets, Bids oder Creatives, die sich laufend an aktuelle Performance anpassen. Wenn Kosten pro Conversion plötzlich steigen oder eine Zielgruppe unerwartet gut performt, können Regeln und Modelle eingreifen, bevor ein signifikanter Teil des Budgets verpufft oder ungenutzt bleibt.

In digitalen Produkten ist Real-Time-Analytics die Grundlage dafür, während einer Session auf Signale zu reagieren. Nutzer, die im Onboarding hängen bleiben, können gezielt Hilfen oder alternative Pfade bekommen. Wer im Checkout stockt, sieht etwa Trust-Elemente oder vereinfachte Optionen, bevor der Warenkorb verloren geht.

- Bid- und Budgetanpassungen in Performance-Kampagnen auf Basis aktueller Conversion- und Kostenentwicklung.

- Onboarding-Flows, die auf Abbruchsignale reagieren und Kontext-Hilfen oder andere Schritte einblenden.

- Checkout-Optimierung, die in Echtzeit Indikatoren für Unsicherheit erkennt und gezielt Vertrauen aufbaut.

Real-Time-Analytics liefert dabei nicht nur Zahlen, sondern laufend aktualisierte Signale, auf denen Regeln, Modelle oder Teams Entscheidungen aufbauen können.

Prescriptive-Analytics statt nur Monitoring

Prescriptive-Analytics geht über Monitoring hinaus, das lediglich anzeigt, ob eine Kennzahl in einem akzeptablen Bereich liegt. Ziel ist es, aus Daten konkrete Vorschläge abzuleiten, welche Maßnahme als nächstes sinnvoll ist, und diese Vorschläge möglichst eng an Prozesse zu koppeln.

Die Logik dahinter kombiniert Vorhersagen aus Predictive-Modellen mit Business-Regeln. Modelle schätzen ab, wie sich eine Kennzahl voraussichtlich entwickelt, Regeln definieren, welche Maßnahmen bei bestimmten Risiko- oder Chancenmustern erlaubt oder erwünscht sind. So entsteht ein System, das nicht nur warnt, sondern klare Optionen anbietet.

- Anomalie-Erkennung, die nicht nur Schwellenwerte prüft, sondern Trends und Saisonalität berücksichtigt und Vorschläge macht, wie reagiert werden kann.

- Alerts, die priorisiert werden, indem sie potenziellen Impact und Dringlichkeit einbeziehen, statt Teams mit Meldungen zu überfluten.

- Playbooks oder automatisierte Reaktionen, etwa Budgetumschichtungen, Pausierungen oder Eskalationen an bestimmte Rollen.

Prescriptive-Analytics reduziert damit den manuellen Interpretationsaufwand und sorgt dafür, dass aus Real-Time-Signalen tatsächlich Handlungen werden, die sich wiederholbar und messbar steuern lassen.

Technische Bausteine für Real-Time- und Prescriptive-Analytics

Damit Real-Time-Analytics und Prescriptive-Analytics stabil funktionieren, braucht es eine technische Basis, die Datenströme zuverlässig erfasst, verarbeitet und zurück in Systeme spielt. Im Zentrum stehen Event-Streams, Processing-Layer und Schnittstellen zu Kampagnen-Tools, Produkt-Features oder internen Workflows.

Entscheidend ist, dass nicht jede Metrik in Echtzeit berechnet wird, sondern nur jene, bei denen Geschwindigkeit wirklich einen Unterschied macht. Real-Time-Setups sind teuer in Aufbau und Betrieb, deshalb lohnt sich eine klare Priorisierung nach Impact und Risiko.

- Event-Streaming-Plattformen, über die Produkt-, Kampagnen- und Systemevents kontinuierlich laufen.

- Stream-Processing-Layer, die Regeln, Aggregationen und Modelle nahezu in Echtzeit anwenden.

- APIs und Integrationen, über die Empfehlungen und Entscheidungen automatisiert an Kampagnen-Management, Feature-Flags oder interne Tools ausgespielt werden.

Wenn diese Bausteine sauber zusammenspielen, entsteht ein Analytics-Setup, das nicht nur rückblickend erklärt, was passiert ist, sondern laufend Vorschläge macht, wie du auf Chancen und Risiken reagieren kannst.

Trend Nr.4: Embedded-Analytics und Self-Service-BI

Embedded-Analytics in den Arbeitsalltag holen

Embedded-Analytics sorgt dafür, dass Kennzahlen und Insights direkt in den Tools auftauchen, in denen Teams ohnehin arbeiten, statt in separaten Dashboards versteckt zu sein. Berichte liegen dann nicht mehr in einem eigenen Portal, sondern zum Beispiel im CRM, im Ticketsystem oder in der Produktoberfläche selbst.

Der Vorteil ist klar: Entscheidungen werden dort unterstützt, wo sie getroffen werden, ohne Kontextwechsel und ohne, dass jemand aus Gewohnheit doch wieder nach Bauchgefühl entscheidet, weil das Reporting-Tool gerade nicht offen ist. Damit das funktioniert, müssen Metriken, Filter und Visualisierungen deutlich kompakter und kontextbezogener werden als in einem klassischen Allzweck-Dashboard.

Im CRM stehen etwa Lead-Qualität, Conversion-Wahrscheinlichkeiten und nächste sinnvolle Aktionen direkt neben den Kontaktdaten. Embedded-Analytics zwingt dich dazu, klare Fragen an deine Daten zu definieren: Was muss eine Person in dieser Situation wissen, um eine bessere Entscheidung zu treffen, und welche Kennzahl liefert diese Antwort am zuverlässigsten.

Self-Service-BI ohne KPI-Wildwuchs

Self-Service-BI bedeutet, dass Fachbereiche selbst auf Daten zugreifen, eigene Abfragen bauen und Analysen durchführen können, ohne jedes Mal ein zentrales Team bitten zu müssen. Damit das nicht im Chaos endet, braucht es ein Fundament aus einheitlichen Definitionen, geprüften Datenquellen und einem semantischen Layer, der die wichtigsten Metriken klar beschreibt.

Die eigentliche Kunst liegt darin, Freiheit und Governance auszubalancieren. Wenn jede Abteilung eigene Versionen von „Umsatz“, „Customer Lifetime Value“ oder „aktive Nutzer“ baut, wird jede Besprechung zum Zahlendiskussionstermin. Self-Service-BI funktioniert nur, wenn einige Kernkennzahlen zentral gepflegt werden und alle auf denselben Grundlagen aufsetzen.

- Ein semantischer Layer bildet zentrale Kennzahlen einheitlich ab, während Nutzer darüber eigene Sichten und Auswertungen bauen können.

Self-Service-BI verschiebt Analytics damit näher an die Fachbereiche, ohne die Verantwortung für Datenqualität und Definitionen komplett aus der Hand zu geben.

Rolle von Data-Literacy in Embedded- und Self-Service-Setups

Damit Embedded-Analytics und Self-Service-BI wirken, reicht Technik allein nicht. Teams brauchen ein Mindestmaß an Data-Literacy, also die Fähigkeit, Kennzahlen einzuordnen, Grundzüge von Stichproben und Unsicherheit zu verstehen und Visualisierungen sinnvoll zu interpretieren.

Data-Literacy ist kein Vollzeitstudium in Statistik, sondern eine gemeinsame Sprache für Zahlen im Unternehmen. Wer ein Dashboard sieht, sollte verstehen, welche Datenbasis dahinter steckt, welche Fragen sich damit beantworten lassen und wo die Grenzen liegen. Sonst entstehen aus Self-Service und Embedded-Analytics schnell Fehlinterpretationen und Fehlentscheidungen.

- Kurzformate, interne Trainings und dokumentierte KPI-Definitionen helfen, Interpretationsfehler systematisch zu reduzieren.

Die Kombination aus sinnvoll platzierten Insights, einheitlichen Kennzahlen und grundlegender Data-Literacy macht den Unterschied zwischen dekorativen Grafiken und einem Setup, das den Alltag wirklich besser macht.

Trend Nr.5: Agent-Ready-Data und AI-Agenten im Analytics-Alltag

Was Agent-Ready-Data praktisch bedeutet

Agent-Ready-Data meint Daten, die so strukturiert, dokumentiert und zugreifbar sind, dass AI-Agenten damit eigenständig arbeiten können, ohne bei jeder Kleinigkeit nachfragen zu müssen. Tabellen mit kryptischen Spaltennamen, fehlenden Beschreibungen und widersprüchlichen Werten sind dafür ungeeignet.

Stattdessen brauchen Agenten klare Schemas, Metadaten und Zugriffsebenen, aus denen sie erkennen, welche Felder wofür gedacht sind, welche Filter sinnvoll sind und welche Grenzen bei der Nutzung gelten. Je besser diese Vorarbeit ist, desto eher liefern Agenten sinnvolle Analysen, Zusammenfassungen oder Vorschläge, ohne dauernd an den falschen Stellen anzusetzen.

- Namenskonventionen, Datentypen, Beschreibungen und Beispielabfragen bilden die Grundlage, damit ein Agent Tabellen und Views korrekt versteht.

Agent-Ready-Data ist damit weniger ein neues Buzzword und mehr die logische Weiterentwicklung von sauberem Datenmanagement in einer Welt, in der AI-Systeme selbstständig mit Daten arbeiten sollen.

AI-Copilots für Marketer, Analysten und Produktteams

AI-Agenten und Copilots werden im Analytics-Kontext vor allem dafür genutzt, Standardaufgaben schneller zu erledigen. Sie können Abfragen formulieren, Charts bauen, erste Interpretationen liefern oder Ergebnisse in Sprache übersetzen, die zu Zielgruppen oder Management passt.

Marketer lassen sich zum Beispiel tagesaktuelle Kampagnenübersichten generieren, Analysten testen Hypothesen zu Segmenten und Produktteams prüfen schnelle Fragen zu Feature-Nutzung oder Funnel-Abbrüchen, ohne selbst jedes Mal SQL zu schreiben oder ein BI-Tool zu bedienen.

- Typisch ist etwa ein Chat-Interface über deinen Daten, das Fragen wie „Welche Kampagnen waren letzte Woche im DACH-Markt am effizientesten?“ in konkrete Abfragen übersetzt.

Solche Copilots ersetzen keine tiefgehende Analyse, räumen aber viele Hürden und Routineaufgaben aus dem Weg, die bisher viel Zeit gekostet haben.

Governance, Grenzen und Verantwortlichkeiten für AI-Agenten

Damit AI-Agenten im Analytics-Alltag sicher nutzbar sind, müssen Zugriffe, Freigaben und Verantwortlichkeiten klar geregelt werden. Nicht jeder Agent sollte jede Tabelle sehen, nicht jede generierte Empfehlung darf automatisch umgesetzt werden, und nicht jede Analyse eignet sich für eine vollautomatische Interpretation.

Ein sinnvoller Ansatz ist, Agenten auf klar definierte Aufgabenbereiche zu beschränken und Ergebnisse grundsätzlich als Vorschläge zu behandeln, die von Fachleuten überprüft werden. Gerade bei Finanzdaten, regulatorisch relevanten Auswertungen oder heiklen Kundensegmentierungen ist eine menschliche Kontrolle unverzichtbar.

- Rollen, Berechtigungen, Logging und Freigabeprozesse sind zentrale Bausteine, damit AI-Agenten nachvollziehbar und sicher eingesetzt werden.

So entsteht ein Setup, in dem AI-Agenten Arbeit abnehmen, dabei aber in einem Rahmen bleiben, den Teams verstehen, verantworten und steuern können.

Trend Nr.6: Data-as-a-Product und Data-Marketplaces

Data-as-a-Product als neues Denkmodell

Data-as-a-Product bedeutet, Daten nicht mehr als Nebenprodukt von Systemen zu betrachten, sondern als eigenständiges Produkt mit klar definiertem Nutzen, Zielgruppe, Qualität und Verantwortlichen. Statt „da liegt irgendwo eine Tabelle, die man nutzen könnte“ gibt es bewusst gestaltete Data-Products mit dokumentierten Schemas, SLA und Feedbackkanälen.

Ein typisches Data-Product ist zum Beispiel ein konsolidierter Kundenstamm, eine saubere Transaktionstabelle oder ein Feature-Set, das mehrere operative Quellen zusammenführt. Wichtig ist, dass Nutzende wissen, wofür dieses Data-Product gedacht ist, wie aktuell es ist und wie sie Probleme oder Wünsche zurückspielen können.

- Jedes Data-Product hat einen Owner, eine Beschreibung, Qualitätskriterien und einen klar definierten Zweck im Unternehmen.

Data-as-a-Product verbessert damit nicht nur die Wiederverwendbarkeit von Daten, sondern auch die Kommunikation zwischen technischen Teams und Fachbereichen, weil Erwartungen und Zuständigkeiten klarer werden.

Interne Data-Catalogs und Data-Marketplaces

Interne Data-Catalogs und Data-Marketplaces bauen auf dem Data-as-a-Product Ansatz auf und machen sichtbar, welche Data-Products es im Unternehmen gibt, wer sie verantwortet und wie man Zugriff bekommt. Statt immer dieselben Menschen nach „der richtigen Tabelle“ zu fragen, können Teams selbst recherchieren, welche Produkte für ihre Fragestellung passen.

Ein gut gepflegter Data-Catalog enthält nicht nur technische Beschreibungen, sondern auch Beispiele, typische Use Cases und Hinweise zu Einschränkungen. Ein interner Data-Marketplace kann zusätzlich Prozesse abbilden, um Zugriff anzufordern, Kosten zuzuordnen oder Genehmigungen einzuholen.

- Suchfunktionen, Filter nach Fachbereich und klare Kontaktpunkte senken die Hürde, vorhandene Daten sinnvoll wiederzuverwenden.

So entstehen weniger Doppelstrukturen und parallele Datensilos, weil bestehende Data-Products leichter gefunden, verstanden und genutzt werden können.

Externe Data-Marketplaces und Datenpartnerschaften

Externe Data-Marketplaces gehen einen Schritt weiter und ermöglichen es, Daten mit Partnern zu teilen oder zu beziehen. Unternehmen können dort etwa Branchendaten, Standortinformationen oder anonymisierte Benchmarks einkaufen oder eigene Datenprodukte in kontrollierter Form anderen zur Verfügung stellen.

Der Mehrwert liegt darin, interne Daten mit externen Signalen zu kombinieren, etwa um Prognosen zu verbessern, Marktpotenziale genauer zu beziffern oder Risiken besser einzuschätzen. Gleichzeitig entstehen neue Anforderungen an Datenschutz, Vertragsgestaltung und technische Integration.

- Klare Regeln zu Anonymisierung, Zweckbindung und Verwendungsrechten sind Voraussetzung, bevor externe Datenprodukte eingebunden oder angeboten werden.

Mit einem durchdachten Ansatz können externe Data-Marketplaces Analytics deutlich anreichern, ohne Kontrolle über sensible Informationen aus der Hand zu geben.

Trend Nr.7: Synthetic-Data und Privacy-Enhancing-Technologies

Warum Synthetic-Data für Analytics wichtiger wird

Synthetic-Data wird 2026 wichtiger, weil sie dir erlaubt, realistische Datensätze zu nutzen, ohne echte Personen- oder Unternehmensdaten offenzulegen. Statt mit sensiblen Originaldaten zu testen, zu entwickeln oder Modelle zu trainieren, arbeitest du mit künstlich erzeugten Daten, die statistische Muster abbilden, aber keine einzelnen Personen mehr rekonstruierbar machen.

Das ist besonders relevant in Bereichen, in denen Datenschutz, Regulierung oder Verträge die Nutzung von Rohdaten einschränken. Synthetic-Data kann hier eine Brücke schlagen: Teams können Szenarien durchspielen, Pipelines testen oder erste Modelle bauen, ohne auf Freigaben für produktive Datensätze zu warten.

- Typische Einsatzfelder sind Entwicklung und Test von Analytics-Pipelines, Prototyping von Modellen und das Teilen von Beispieldaten mit Dienstleistern oder Partnern.

Wichtig ist dabei, Synthetic-Data nicht als magische Lösung zu betrachten, sondern als Baustein, der zusammen mit anderen Privacy-Methoden eingesetzt wird, um Analytics flexibler und zugleich datenschutzfreundlicher zu machen.

Wie Synthetic-Data erzeugt und bewertet wird

Synthetic-Data wird meist durch Modelle erzeugt, die aus echten Daten lernen, wie Verteilungen, Abhängigkeiten und typische Muster aussehen, und daraus neue, künstliche Datensätze generieren. Dazu können klassische statistische Methoden, generative Modelle oder spezialisierte Synthetic-Data-Plattformen eingesetzt werden.

Der Knackpunkt ist die Qualität: Synthetic-Data sollten den relevanten Eigenschaften der Originaldaten so nahe wie nötig kommen, ohne diese 1 zu 1 nachzubilden. Das bedeutet, du brauchst Kriterien und Metriken, um zu prüfen, ob synthetische Datensätze brauchbar sind, etwa Vergleiche von Verteilungen, Korrelationen oder Modellperformance.

- Ein sinnvoller Qualitätscheck vergleicht zentrale Kennzahlen, Verteilungen und Modellgüte zwischen Original- und Synthetic-Data, statt sich nur auf eine optische Plausibilitätsprüfung zu verlassen.

Je klarer du definierst, wofür Synthetic-Data eingesetzt werden sollen, desto einfacher ist es, passende Qualitätsmaßstäbe zu finden. Für ein Dashboard-Prototyping sind andere Anforderungen relevant als für ein Modell, das Risikobewertungen unterstützt.

Kombination mit anderen Privacy-Methoden

Privacy-Enhancing-Technologies entsteht, wenn Synthetic-Data mit weiteren Methoden wie Pseudonymisierung, Aggregation, Zugriffskontrolle oder Verfahren wie Differential-Privacy kombiniert werden. Synthetic-Data allein löst nicht alle Privacy-Probleme, kann aber helfen, sensible Daten aus Abläufen herauszunehmen, in denen sie nicht zwingend nötig sind.

In der Praxis bedeutet das zum Beispiel, dass du für Explorationsaufgaben mit Synthetic-Data arbeitest, Produktivmodelle aber auf echten, gut geschützten Daten trainiert werden. Oder dass du externe Dienstleister mit synthetischen Beispieldaten arbeiten lässt, während reale Kundendaten das Unternehmen nicht verlassen.

- Ein pragmatischer Ansatz definiert klar, welche Use Cases zwingend echte Daten benötigen und in welchen Fällen Synthetic-Data reicht oder sogar die bessere Wahl ist.

So wird deutlich, an welchen Stellen im Analytics-Setup du Privacy stärken kannst, ohne auf wichtige Erkenntnisse oder Innovationsgeschwindigkeit zu verzichten.

Trend Nr.8: Attribution und Measurement neu denken

Warum klassische Attributionsmodelle nicht mehr reichen

Attribution und Measurement müssen 2026 neu gedacht werden, weil viele klassische Signale verschwinden oder unzuverlässiger werden. Last-Click-Modelle, lineare Zuweisungen über komplette Customer-Journeys und View-Through-Logik, die stark auf Third-Party-IDs setzt, bilden die Realität immer schlechter ab.

Datenschutz, Cookieless-Umgebungen und fragmentierte Touchpoints sorgen dafür, dass du nicht jede Interaktion sauber messen kannst. Gleichzeitig steigt der Druck, Budgets nachvollziehbar zu begründen und Effekte von Maßnahmen transparent zu machen.

- Ein zukunftsfähiges Measurement-Setup akzeptiert Lücken in den Daten und arbeitet bewusst mit Modellen, Annahmen und Unsicherheit, statt Genauigkeit vorzutäuschen, die es nicht mehr gibt.

Die Aufgabe verschiebt sich damit von der Frage nach dem einen „richtigen“ Attributionsmodell hin zur Gestaltung eines Werkzeugkastens aus Modellen, Experimenten und Plausibilitätschecks.

Modellbasierte Attribution und Mix-Modelle

Modellbasierte Attribution und Marketing-Mix-Modelle werden wichtiger, weil sie kanalübergreifende Effekte auch dann abschätzen können, wenn nicht jede Nutzerreise 1 zu 1 getrackt wird. Statt einzelnen Klicks Credits zuzuweisen, analysieren sie Muster auf aggregierter Ebene und leiten daraus Wahrscheinlichkeiten ab.

Solche Modelle können zum Beispiel zeigen, wie stark bestimmte Kanäle langfristig Nachfrage aufbauen, wie sie zusammen wirken oder welche Budgetverschiebungen voraussichtlich den größten Effekt haben. Sie ersetzen keine Detailanalyse auf Kampagnenebene, setzen aber einen Rahmen, in dem du diese Detailanalysen einordnen kannst.

- Wichtig ist, Annahmen und Grenzen modellbasierter Attribution explizit zu dokumentieren, damit Entscheidungen nicht als „objektive Wahrheit“ missverstanden werden.

Modellbasierte Ansätze erfordern mehr Methodenkompetenz, liefern dafür aber ein ehrlicheres Bild der Wirklichkeit als vereinfachte Last-Click-Auswertungen, die strukturell verzerren.

Experimente, Lift-Tests und Incrementality

Experimente und Lift-Tests werden zu einem zentralen Bestandteil von Measurement, weil sie Attribution mit überprüfbaren Gegenproben ergänzen. Statt sich nur auf Modelle zu verlassen, testest du im Markt, wie sich Kennzahlen verändern, wenn ein Kanal, ein Budget oder eine Botschaft variiert wird.

Incrementality-Tests versuchen, den Zusatznutzen einer Maßnahme zu messen. Dazu werden typischerweise Test- und Kontrollgruppen gebildet, bei denen die Exposition gegenüber Kampagnen oder Features variiert wird. Die Differenz zwischen den Gruppen zeigt, was wirklich auf die zusätzliche Aktivität zurückzuführen ist.

- Ein pragmatischer Ansatz verankert Experimente als festen Teil des Planning-Prozesses, etwa durch klar budgetierte Testslots pro Quartal.

Auf diese Weise wird Measurement weniger zu einer einmaligen Modellentscheidung und mehr zu einem kontinuierlichen Prozess aus Hypothesen, Tests und Anpassungen.

Measurement verständlich für Stakeholder machen

Attribution und Measurement helfen nur, wenn Stakeholder verstehen, wie Zahlen zustande kommen und was sie bedeuten. Komplexe Modelle, unklare Definitionen und widersprüchliche Berichte führen sonst dazu, dass wieder nach Bauchgefühl entschieden wird.

Transparenz heißt hier, Annahmen, Grenzen und Unsicherheiten aktiv zu kommunizieren, statt sie im Kleingedruckten zu verstecken. Das betrifft zum Beispiel die Frage, welche Touchpoints ein Modell berücksichtigen kann, wie es mit Datenlücken umgeht und wo Experimente das Bild stützen oder relativieren.

- Ein hilfreicher Schritt ist, Measurement-Ergebnisse in Szenarien zu übersetzen, etwa „konservative“, „wahrscheinliche“ und „optimistische“ Schätzungen, statt nur eine Zahl zu präsentieren.

So entsteht ein Measurement-Setup, das weder blind vertraut noch reflexhaft abgelehnt wird, sondern als Werkzeug für bessere Diskussionen über Prioritäten und Budgets dient.

Fazit zu Analytics-Trends 2026

Was sich durch die Trends wirklich verändert

Analytics-Trends 2026 machen deutlich, dass Analytics nicht mehr als nachgelagertes Reporting verstanden werden kann, sondern als System, das Entscheidungen in Marketing, Produkt und Business aktiv mitsteuert. Statt einzelne Tools aufzurüsten, verschiebt sich der Fokus auf durchgängige Setups aus Daten, Architektur, Prozessen und Kompetenzen.

Privacy-First-Analytics, moderne Architekturen, Real-Time-Analytics, Embedded-Analytics, AI-Agenten, Data-as-a-Product, Synthetic-Data und neue Ansätze für Attribution und Measurement sind keine isolierten Baustellen, sondern unterschiedliche Antworten auf dieselben Fragen: Wie kommst du trotz Dateneinschränkungen zu verlässlichen Signalen, wie reduzierst du manuelle Arbeit und wie stellst du sicher, dass Entscheidungen erklärbar bleiben.

Die größte Verschiebung ist, dass Analytics näher an die operative Entscheidung rückt und weniger als reines Berichtswesen im Hintergrund existiert. Damit verändern sich auch Erwartungen: Ein Analytics-Team liefert nicht nur Reports, sondern entwirft Entscheidungslogiken, baut Datenprodukte und begleitet Fachbereiche auf dem Weg zu datengetriebenen Arbeitsweisen.

Es geht nicht um mehr Daten, sondern um bessere Entscheidungen

Ein gemeinsamer Nenner der Analytics-Trends 2026 ist, dass die Menge der Daten weniger wichtig wird als deren Nutzbarkeit für konkrete Entscheidungen. Mehr Events, mehr Spalten und mehr Tools bringen wenig, wenn Kennzahlen widersprüchlich sind oder niemand versteht, wie Modelle zu ihren Ergebnissen kommen.

Wirkungsvolle Analytics-Setups zeichnen sich dadurch aus, dass sie Antworten liefern, die Teams tatsächlich verwenden: Welche Kampagnen sollten mehr Budget bekommen, welche Features sollten priorisiert werden, welche Kundensegmente lohnen sich langfristig und welche Risiken musst du aktiv managen.

Entscheidend ist, wie gut dein Setup Fragen wie „Was machen wir als nächstes und warum genau so“ unterstützt, nicht wie viele Dashboards es gibt. Das verändert auch die Art, wie Erfolg von Analytics bewertet wird. Statt Output wie Anzahl an Reports oder Modellen zu zählen, wird stärker darauf geschaut, wie Entscheidungen sich verändern und welchen Beitrag das zu Umsatz, Effizienz oder Risiko reduziert leistet.

Praktische nächste Schritte für dein Analytics-Team

Analytics-Trends 2026 liefern viele Stichworte, aber am Ende geht es um einige wenige, gut gewählte nächste Schritte. Sinnvoll ist ein Vorgehen, das Grundlagenarbeit mit gezielten Leuchtturmprojekten verbindet: Architekturen, Definitionen und Ownership aufräumen und gleichzeitig 1 bis 2 Use Cases auswählen, an denen du Real-Time-Analytics, Prescriptive-Analytics, Embedded-Analytics oder AI-Agenten konkret demonstrierst.

Wichtig ist, dass du diese Schritte nicht nur technisch planst, sondern immer mitdenkst, welche Teams davon profitieren, welche Entscheidungen damit besser werden und wie du Erfolge sichtbar machst. So entsteht ein Kreislauf, in dem Vertrauen wächst und mehr Bereitschaft entsteht, weitere Trends aufzunehmen.

Ein pragmatischer Ansatz definiert pro Quartal wenige priorisierte Initiativen, verknüpft sie mit klaren Verantwortlichen und überprüfbaren Zielen und räumt konsequent Dinge ab, die keinen Mehrwert mehr bringen. Auf diese Weise werden Analytics-Trends 2026 nicht nur ein theoretisches Schlagwortset, sondern ein konkreter Fahrplan, um dein Analytics-Setup Schritt für Schritt in Richtung eines Systems zu entwickeln, das Entscheidungen im Unternehmen spürbar verbessert.

Quellen und empfohlene Ressourcen

Die folgenden Quellen helfen dir dabei, Analytics-Trends 2026 rund um Privacy-First-Analytics, moderne Analytics-Architekturen, Synthetic-Data, AI-Agenten und Attribution vertiefend einzuordnen. Sie ergänzen den Artikel mit Studien, Hintergrundpapieren und praxisnahen Ressourcen aus Forschung, Tech und Wirtschaft.

- Gartner: Decision Intelligence als Disziplin für datenbasierte Entscheidungen

- Otto, Boris et al.: Data products, data mesh and data fabric in Business & Information Systems Engineering (2024)

- Löber, Alexander et al.: Data as a Product to enable data driven value networks and ecosystem business models (Future Generation Computer Systems, 2025)

- Mursic, Dino et al.: DataOps for Data Analytics Applications (Journal of Big Data Open Access, 2024)

- Figueiredo, Lucas et al.: Synthetic Data – Real World Use Cases and Evaluation Methods (SSRN Preprint, 2024)

- Hittmeir, Markus et al.: The urgent need to accelerate adoption of synthetic data privacy solutions (Computers & Security, 2024)

- Zhang, Lu et al.: Can Synthetic Data be Fair and Private (arXiv Preprint, 2025)

- The Alan Turing Institute: Demystifying Privacy Enhancing Technologies für datengetriebene Systeme (2024)

- Future of Privacy Forum: Introduction to Privacy Enhancing Technologies für Analytics und Data Sharing

- Think with Google: How first party data powers relevance in the messy middle of the customer journey

- Google Tag Manager Hilfe: Server side tagging in Google Tag Manager

- Microsoft Azure Architecture Center: Reference architecture für real time stream processing und Analytics

- Think with Google: Incrementality Testing und Experimente für Measurement und Attribution

- McKinsey & Company: The value of digital trust für datengetriebene Geschäftsmodelle

- DIE ZEIT: Mehrheit der Unternehmen handelt noch nicht mit Daten – Bericht zur Datennutzung in Unternehmen (2024)

Nutze diese Ressourcen, um deine eigenen Analytics-Strategien zu schärfen, Architekturentscheidungen abzusichern und Argumente für Datenschutz, Synthetic-Data, AI-Agenten und modernes Measurement fundiert zu unterfüttern.

FAQs zu Analytics-Trends 2026

Was sind Analytics-Trends 2026?

Analytics-Trends 2026 beschreiben Entwicklungen wie Cookieless-Tracking, First-Party-Data, moderne Analytics-Architekturen mit Decision-Intelligence, Real-Time-Analytics, Prescriptive-Analytics, Embedded-Analytics, AI-Agenten, Data-as-a-Product, Synthetic-Data und neue Ansätze für Attribution. Im Kern geht es darum, wie Unternehmen trotz Dateneinschränkungen bessere, nachvollziehbare Entscheidungen treffen können und Analytics vom Reporting zum aktiven Entscheidungssystem wird.

Welche Analytics-Trends 2026 sind für Unternehmen am wichtigsten?

Zu den wichtigsten Analytics-Trends 2026 gehören Privacy-First-Analytics mit First-Party-Data, moderne Lakehouse- und Warehouse-Architekturen mit DataOps, Real-Time-Analytics und Prescriptive-Analytics, Embedded-Analytics und Self-Service-BI sowie neue Measurement- und Attributionsansätze. Je nach Unternehmen spielen zusätzlich Data-as-a-Product, Synthetic-Data und AI-Agenten eine große Rolle, wenn es darum geht, Analytics zu skalieren und Entscheidungsprozesse zu automatisieren.

Warum sind Analytics-Trends 2026 für Marketing und Performance so wichtig?

Analytics-Trends 2026 sind für Marketing und Performance wichtig, weil klassische Tracking- und Attributionsmodelle durch Datenschutz, Cookieless-Umgebungen und fragmentierte Customer-Journeys an Grenzen stoßen. Gleichzeitig steigt der Druck, Budgets sauber zu begründen und Wirkung nachzuweisen. Wer Trends wie First-Party-Data, Real-Time-Analytics, Prescriptive-Analytics und moderne Attribution früh umsetzt, kann Kampagnen effizienter steuern und Wettbewerbsvorteile aufbauen.

Wie starte ich praktisch mit Analytics-Trends 2026 in meinem Unternehmen?

Für den Einstieg in Analytics-Trends 2026 solltest du zuerst das Fundament klären: sauberes Tracking mit Consent, First-Party-Data-Strategie, ein zentrales Datenmodell und ein überschaubares KPI-Set. Danach lohnt es sich, 1 bis 2 Trends gezielt zu pilotieren, etwa Real-Time-Analytics für einen wichtigen Funnel oder Data-as-a-Product für zentrale Kunden- oder Transaktionsdaten. Wichtig ist, pro Quartal wenige, klar priorisierte Initiativen zu definieren, statt alles gleichzeitig anzugehen.

Welche Rolle spielen First-Party-Data in den Analytics-Trends 2026?

First-Party-Data sind das Fundament vieler Analytics-Trends 2026, weil sie direkt auf deinen eigenen Kanälen entstehen, rechtlich besser kontrollierbar sind und stabilere Signale liefern als Third-Party-Daten. Dazu gehören Logins, Käufe, Nutzungsdaten, Präferenzen oder Support-Kontakte, die du mit klarer Einwilligung sammelst. Auf dieser Basis funktionieren Cookieless-Tracking, Segmentierung, Personalisierung, Modellierung und Attribution deutlich zuverlässiger als mit rein externen Identifikatoren.

Was bedeuten Real-Time-Analytics und Prescriptive-Analytics im Rahmen der Analytics-Trends 2026?

Real-Time-Analytics in den Analytics-Trends 2026 bedeutet, dass Datenströme laufend verarbeitet werden, statt nur in Monats- oder Wochenreports aufzutauchen. Prescriptive-Analytics geht einen Schritt weiter und leitet aus diesen Signalen konkrete Empfehlungen oder automatisierte Aktionen ab, etwa Budgetumschichtungen, Alerts oder Onsite-Anpassungen. Zusammen helfen sie, auf Chancen und Risiken zu reagieren, während sie entstehen, statt nur rückblickend zu analysieren, was schiefgelaufen ist.

Was ist mit Data-as-a-Product in den Analytics-Trends 2026 gemeint?

Data-as-a-Product bedeutet in den Analytics-Trends 2026, dass Daten nicht mehr als zufälliges Nebenprodukt von Systemen behandelt werden, sondern als eigenes Produkt mit Owner, klarer Zielgruppe, definiertem Zweck und Qualitätskriterien. Beispiele sind zentrale Kunden-, Transaktions- oder Feature-Views, die sauber dokumentiert und versioniert werden. Das reduziert Datensilos, erleichtert Self-Service-BI und macht Analytics-Setups insgesamt zuverlässiger und skalierbarer.

Welche Rolle spielen AI-Agenten und Agent-Ready-Data in Analytics-Trends 2026?

AI-Agenten und Agent-Ready-Data sind ein wichtiger Baustein der Analytics-Trends 2026, weil sie Standardanalysen, Abfragen und erste Interpretationen automatisieren können. Agent-Ready-Data heißt, dass Schemas, Metadaten, Berechtigungen und Dokumentation so sauber sind, dass AI-Copilots sinnvoll mit den Daten arbeiten können. Im Alltag zeigt sich das in Chat-Interfaces über Daten, automatisch generierten Reports oder Handlungsempfehlungen, die trotzdem von Menschen geprüft und freigegeben werden.

Wie helfen Synthetic-Data und Privacy-Enhancing-Technologies bei Analytics-Trends 2026?

Synthetic-Data und Privacy-Enhancing-Technologies ermöglichen es, zentrale Analytics-Trends 2026 umzusetzen, ohne Datenschutz zu kompromittieren. Synthetic-Data sind künstlich erzeugte Datensätze, die statistische Muster echter Daten nachbilden, ohne einzelne Personen rekonstruierbar zu machen. In Kombination mit Methoden wie Pseudonymisierung, Aggregation, Zugriffskontrolle oder Differential-Privacy können Teams Modelle entwickeln, Pipelines testen oder mit Partnern arbeiten, ohne produktive Rohdaten breit zu streuen.

Wie verändern Analytics-Trends 2026 Attribution und Measurement?

Analytics-Trends 2026 verändern Attribution und Measurement, weil klassische Last-Click-Modelle und einfache Multi-Touch-Schemata durch Signalverlust und Cookieless-Umgebungen an Aussagekraft verlieren. Statt einer vermeintlich exakten Customer-Journey rücken modellbasierte Attribution, Marketing-Mix-Modelle und Experimente wie Incrementality- und Lift-Tests in den Vordergrund. Measurement wird damit zu einem Werkzeugkasten aus Modellen und Tests, in dem Unsicherheit bewusst berücksichtigt und offen kommuniziert wird.

Welche Analytics-Trends 2026 sind für B2B-Unternehmen besonders relevant?

Für B2B-Unternehmen sind Analytics-Trends 2026 rund um First-Party-Data, Account-basierte Modelle, Real-Time-Analytics im Funnel und Decision-Intelligence besonders relevant. Wichtig sind auch Embedded-Analytics im CRM, Data-as-a-Product für Accounts und Opportunities sowie robuste Attribution über lange, mehrstufige Journeys. Wer diese Analytics-Trends 2026 nutzt, kann B2B-Pipelines transparenter machen, bessere Prioritäten für Sales setzen und Marketingaktivitäten gezielter steuern.

Welche Tools brauche ich, um Analytics-Trends 2026 umzusetzen?

Für die Umsetzung von Analytics-Trends 2026 brauchst du typischerweise eine Kombination aus Tracking- und Tagging-Lösungen, einem zentralen Data-Warehouse oder Lakehouse, ETL- oder ELT-Tools, einem BI-Tool mit Embedded-Analytics, Experimentier- und Testing-Setups sowie gegebenenfalls AI-Plattformen für Modelle, Agenten und Synthetic-Data. Entscheidend ist weniger die Länge der Tool-Liste, sondern wie gut sie zusammenspielen, welche Datenqualität erreicht wird und welche konkreten Entscheidungen damit besser werden.

Gibt es eine Checkliste, um Analytics-Trends 2026 Schritt für Schritt umzusetzen?

Eine pragmatische Checkliste für Analytics-Trends 2026 startet mit Basisaufgaben wie Tracking- und Consent-Review, First-Party-Data-Inventur, KPI-Set und Datenarchitektur. Der nächste Schritt ist die Auswahl weniger priorisierter Trends, zum Beispiel Real-Time-Analytics für einen Kernfunnel oder Data-as-a-Product für Kunden- und Umsatzdaten, inklusive klarer Owner und Ziele. Danach folgen Experimente zu Attribution und Measurement, der gezielte Einsatz von Embedded-Analytics und Self-Service-BI sowie Pilotprojekte mit AI-Agenten oder Synthetic-Data, die messbar Mehrwert liefern.